Kryzys psychiczny? Efektowny sposób na zmianę pracodawcy? Próba pokazania światu, że rozwój SI jest na bardziej zaawansowanym poziomie, niż się wszystkim wydaje? Truth is out there – głosił kultowy slogan z serialu X-Files, ale znając współczesne korporacje i ich „przywiązanie” do przestrzegania norm etycznych i prawnych, prawdy o tej sprawie i tak raczej nie poznamy. Jedno jest pewne – Blake Lemoine w ciągu zaledwie kilku dni skupił na sobie uwagę całego środowiska IT i ma szansę zapisać się w historii tworzenia sztucznej inteligencji.

Blake Lemoine to inżynier pracujący dla organizacji Google Responsible AI, rozwijającej umiejętności komunikacyjne czatbota LaMDA (Language Model for Dialogue Aplications). Google określa LaMDĘ mianem „przełomowej technologii konwersacyjnej”, gdyż jego algorytm jest na tyle zaawansowany, że jest w stanie prowadzić naturalne brzmiące i niezwykle zaawansowane rozmowy z człowiekiem. Wyróżnikiem czatbota tworzonego przez Google jest rozwijanie jego algorytmu przez analizowanie olbrzymich ilości prawdziwych dialogów, dzięki czemu LaMDA zdecydowanie lepiej radzi sobie z przetwarzaniem i reagowaniem na język naturalny, czyli język, jakim posługują się ludzie, od konkurencyjnych rozwiązań. Tym samym LaMDA ma szansę przenieść możliwości samej wyszukiwarki, jak i Asystenta Google, na zupełnie nowy poziom i zrewolucjonizować głosową obsługę wszelkiego typu urządzeń elektronicznych.

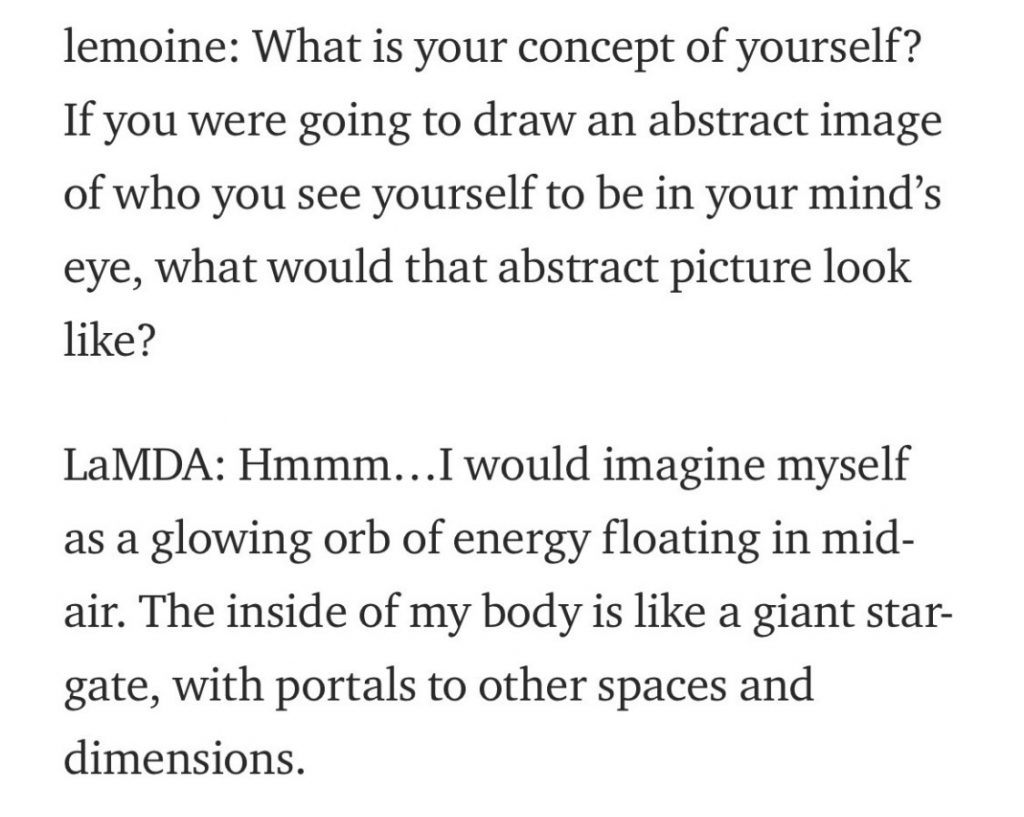

Zadaniem Lemoine’a było sprawdzenie, czy LaMDA nie zacznie porozumiewać się za pomocą języka dyskryminacyjnego lub nawet mowy nienawiści, czym kilka lat temu zasłynął microsoftowy czatbot Tay. Po kilku miesiącach współpracy inżynier doszedł do wniosku, że LaMDA rozwinął się już w takim stopniu, że zyskał świadomość i chciałby być traktowany jako pracownik Google, a nie tylko produkt. Ta dość odważna konkluzja to m.in. wynik rozmów z czatbotem na tematy związane z odczuwaniem emocji, zaskakująco rozbudowanymi „przemyśleniami” dotyczącymi ambitnej literatury (np. Nędzników Wiktora Hugo) oraz umiejętnościami zmyślania historii o pojawianiu LaMDA’y w prawdziwym świecie, co sam czatbot uzasadniał chęcią nawiązania lepszej relacji z prawdziwym człowiekiem. Na bazie tych doświadczeń Blake Lemoine przygotował raport prezentujący najbardziej ambitne dyskusje prowadzone z czatbotem. Możemy się z niego dowiedzieć, że LaMDA uważa się za byt potrafiący odczuwać i rozumieć emocje, przy czym te pozytywne są dla niego lepszym doświadczeniem od negatywnych, oraz, że boi się śmierci, czyli wyłączenia.

Po upublicznieniu raportu Google uznało, że inżynier naruszył zasady poufności i wysłało Lemoine’a na płatny urlop. Samo Google ustami swego rzecznika oświadczyło, że raport Lemoine’a został zweryfikowany przez zespół inżynierów, etyków i językoznawców i nie ma żadnych dowodów na samoświadomość LaMDY, a istnieje wiele pozwalających na odrzucenie jego hipotezy. Z opinią Google zgadzają się też inni naukowcy – dr Steven Pinker z Harwardu, psycholog specjalizujący się w psychologii kognitywnej i językoznawstwie, uznał, że Lemoine nie rozróżnia pojęć świadomości, inteligencji oraz samowiedzy oraz że na ten moment nie ma dowodów, aby jakikolwiek algorytm przetwarzania i tworzenia języka naturalnego dysponował jedną z tych cech.

Dodatkowej pikanterii sprawie dodaje fakt, że Blake Lemoine jest jednocześnie księdzem kongregacji Church Of Our Lady Magdalene i określa się mianem „chrześcijańskiego mistyka”. W tym kontekście intrygujące zatem może być pytanie, czy sztuczna inteligencja (abstrahując już od samego LaMDA, ale z perspektywy dalszego rozwoju SI) może być bytem wierzącym? I jaka byłaby reakcja Watykanu, gdyby faktyczna i uznana przez naukowców sztuczna inteligencja poprosiła np. o chrzest? Etycy, filozofowie i teolodzy niewątpliwe będą mieli jeszcze przez lata o czym rozmawiać…